Scriptorij sprak met machine learning experte Anna Krogager van ML 6

AI is een buzzwoord dat je meer en meer hoort vallen. Wie taal en artificiële intelligentie intikt in Google komt al snel meer van die jargonwoorden tegen. Denk aan machine learning, deep learning en natural language processing. Maar wat betekenen die nu eigenlijk? En zeker op het vlak van taal. Scriptorij trok naar het Gentse ML6 en sprak met wiskundige en machine learning experte Anna Krogager.

AI is een buzzwoord dat je meer en meer hoort vallen. Wie taal en artificiële intelligentie intikt in Google komt al snel meer van die jargonwoorden tegen. Denk aan machine learning, deep learning en natural language processing. Maar wat betekenen die nu eigenlijk? En zeker op het vlak van taal. Scriptorij trok naar het Gentse ML6 en sprak met wiskundige en machine learning experte Anna Krogager.

AI betekent Artificiële Intelligentie en wil menselijke intelligentie nabootsen in een machine. Dat is de essentie. Alles is te vatten in een regel ‘if this, then that’ (Als we dit doen, dan moet je dat doen). Zonder het te weten zit heel ons leven vol van dergelijke condities. Bijvoorbeeld:

- Als we water willen drinken, neem dan een glas uit de kast.

- Als we naar buiten gaan, doe je schoenen aan.

- Als je de auto wil starten, draai de sleutel in het contact. Enzovoort.

Veel routinetaken vormen zo de basis van menselijke intelligentie. En dat is precies wat een computer probeert in te schatten.

Machine learning

Wordt de computer nog een stukje slimmer, dan komen we uit bij machine learning. Bij machine learning leert de machine zelf op basis van data die hij inleest. Hoe doet hij dat? Door in het begin één neural netwerk vast te leggen en daar vervolgens continu trainingsdata door te sturen om de parameters van het netwerk te verbeteren. Na enorm veel data herkent hij zo patronen en gelijkenissen. Machine learning werkt dus niet volgens de regel ‘if this, then that’.

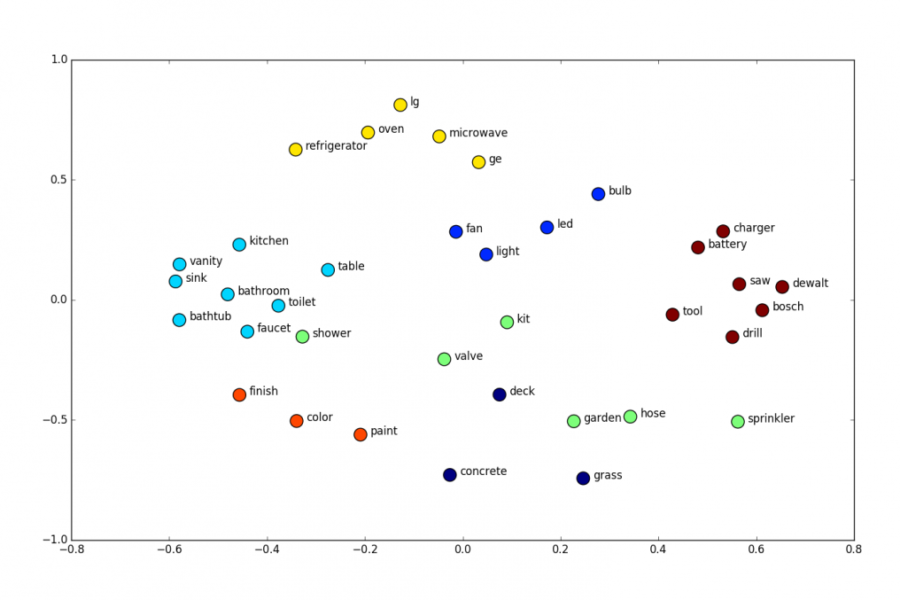

Bijvoorbeeld: je laat een robot scrawlen door honderdduizenden tekstpagina’s van Wikipedia. Dan zal die – bijvoorbeeld – op een bepaald moment opmerken dat het werkwoord ‘schrijven’ vaak voorkomt in combinatie met ‘boeken’ of ‘teksten’ of ‘balpen’ … Zo begint de machine verbanden te leggen. En zal hij die woorden qua betekenis dichter bij elkaar associëren. Dat wordt gevisualiseerd als word embeddings of woordrepresentaties (zie foto). De machine leert dus op basis van alle data die hem wordt voorgeschoteld en zoekt daarin patronen. Belangrijk: je moet veel trainingsdata aanbieden alvorens de machine kan leren. Hoe meer data, hoe accurater hij wordt. Gelukkig is er op het internet een quasi oneindige bron van tekstdata te vinden.

Deep learning

Wordt de machine nog een stapje slimmer, dan spreken we over deep learning. Want net zoals machine learning een onderdeel is van AI, is ook deep learning een onderdeel van machine learning. Deep van deep learning verwijst naar het aantal berekeningen dat een machine doet na elkaar. Bij machine learning gaat het over artificiële neurale netwerken die uit berekeningen bestaan. Bij Deep Learning netwerking heb je meerdere lagen van berekeningen.

Je merkt wellicht: van alle jargonwoorden is ‘neuraal netwerk’ een cruciaal woord bij deep learning. Het klinkt heel fancy. Maar eenvoudig gesteld komt het hierop neer: het is een wiskundig model waar je in elke neuron een wiskundige berekening doet op basis van input. En dat stuur je vervolgens door naar de volgende neuron die de volgende berekening doet. Eigenlijk is dat geïnspireerd op het menselijke brein. Van bij de geboorte zijn er ongeveer 100 miljard neuronen aanwezig in onze hersenen.

Bijvoorbeeld: ‘als het regent doe ik m’n jas aan maar als het hevig regent neem ik ook een paraplu mee, laarzen en ga ik niet met de fiets maar met de tram.’

Dergelijke gedachte is een exponent van de intelligentie van het menselijke brein en vindt plaats in een fractie van een seconde. Wel, het is dat mechanisme dat ook speelt bij deep learning. En het revolutionaire is dat een machine dat – na een enorme input van data – ook zelf kan beginnen te leren.

Natural Language Processing

Anna is bij ML6 de Natural Language Processing experte. Natural Language Natural Language Processing (NLP) is een vorm van AI waar deep learning technieken soms (maar niet altijd) worden op toegepast. Het is het analyseren van gesproken en geschreven taal. En dat zowel op het gebied van semantiek, syntaxis … Opnieuw gaat de machine patronen herkennen in taal. En uiteraard kom je dan uit bij de grammatica. Alleen, bij Natural Language Processing spreek je niet van woorden, maar van tokens. En een zin wordt een sequentie.

Helemaal nieuw zijn die inzichten natuurlijk niet. Zoals elke innovatie voortbouwt op de vorige, heeft hier taalkundige Noam Chomsky baanbrekend werk geleverd. In de jaren 50 was hij de grondlegger van de transformationele generatieve grammatica. Daarin zag hij zinnen als een formele uitdrukking van het alfabet van letters. Op dat moment een zeer vernieuwende kijk op taal. Want taal werd benaderd als een wiskundig systeem dat logisch in elkaar zat en werkt met terugkerende patronen. Vanaf toen werden die technieken routinematig toegepast op de definitie van computertalen.

AI AI HOERA!?

Meer van dit? Kom op donderdag 21 november naar AI AI Hoera!? De Scriptorij conferentie over de impact van artificiële intelligentie op copy en communicatie. En Scriptorij bestaat 15 jaar! De plaatsen zijn beperkt. Snel zijn is de boodschap.

Meer lezen? Kom hier alles te weten over hoe een machine taal verwerkt.